Gustavo Adolfo La Fontaine

El 30 de noviembre de 2022, OpenAI lanzó al mercado una implementación de su modelo grande de lenguaje, esta versión orientada al público consumidor lleva por nombre ChatGPT. La aplicación del lado del usuario es relativamente sencilla, es una interfaz parecida a la de servicios de mensajería como What’sApp o Facebook Messenger; sin embargo, lo que está detrás es un poderoso modelo matemático que tiene la capacidad de predecir con gran precisión el lenguaje humano.

Un modelo grande de lenguaje, como GPT-3.5 o GPT-4, es una forma avanzada de inteligencia artificial que utiliza técnicas de aprendizaje automático para generar texto que parece humano. Estos modelos son entrenados en vastos conjuntos de datos textuales como libros, artículos de noticias y páginas web, y aprenden a predecir la próxima palabra en una secuencia de texto basándose en las palabras anteriores. Esto les permite generar respuestas a preguntas, completar frases, escribir ensayos y realizar una variedad de otras tareas lingüísticas con un alto grado de coherencia y relevancia.

La forma en que funcionan estos modelos se basa en lo que se conoce como «transformadores», una arquitectura de red neuronal que utiliza mecanismos de atención para ponderar diferentes partes de la entrada al generar una salida. Esto significa que puede tener en cuenta el contexto a largo plazo, lo que le permite generar respuestas más relevantes y precisas.

Ya para enero de 2023, ChatGPT se habría convertido en la aplicación con la adopción más rápida en la historia moderna, captando a más de cien millones de usuarios en menos de dos meses y derrocando al antiguo titán Instagram (Curry, 2023). Los gigantes tecnológicos como Amazon, Google y Meta respondieron de inmediato, anunciando en tiempo récord sus propios modelos grandes de lenguaje y ofreciendo productos orientados tanto a desarrolladores como a usuarios.

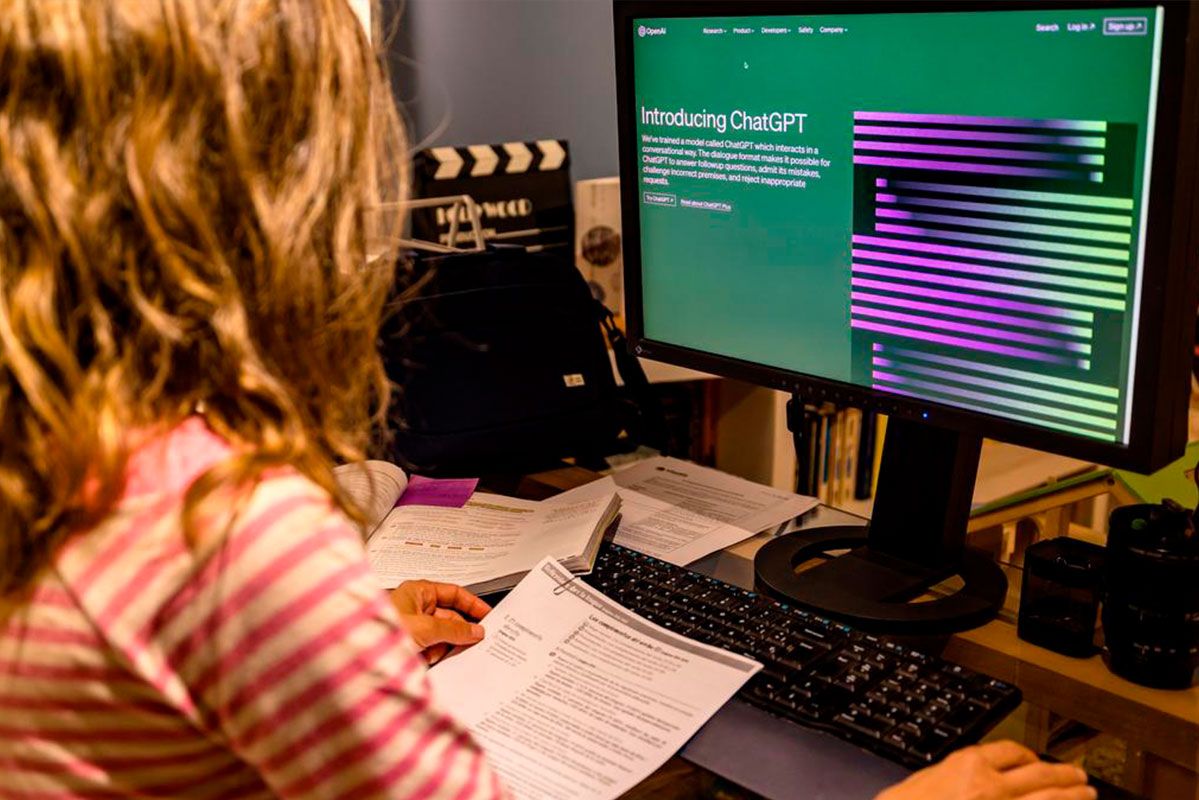

La rápida adopción de esta tecnología en el ámbito de la educación es sorprendente, por ejemplo, uno de los primeros estudios de opinión en el ámbito educativo sobre ChatGPT, realizado por Walton Family Foundation (2023), encontró que, de 1.300 profesores encuestados en Estados Unidos, 51 % ya estaba activamente incorporando esta herramienta en sus actividades pedagógicas, incluyendo preparación de clases, revisión de contenido y apoyo creativo para el diseño de actividades en el aula.

Por otro lado, este mismo estudio encontró que uno de cada tres estudiantes con edades comprendidas entre doce y diecisiete años admite abiertamente que utiliza ChatGPT como asistente a la hora de hacer su trabajo académico. De los profesores y estudiantes que utilizan la herramienta, 80 % dice que ha tenido un impacto positivo en su vida, con el resto considerando que el impacto ha sido neutral.

Estudios académicos preliminares han encontrado resultados similares (Lo, 2023), siendo economía, derecho y otras disciplinas afines las que han tenido mayor aceptación de la aplicación, mientras que en disciplinas menos relacionadas con el uso del lenguaje, como es el caso de matemáticas, la opinión es más bien negativa, considerando que es una herramienta deficiente para el desempeño de actividades en el área.

Las respuestas negativas provenientes de la comunidad de matemáticas no son sorprendentes, teniendo en cuenta las limitaciones inherentes a los modelos de lenguaje como GPT-3.5 y GPT-4 (los modelos detrás de ChatGPT). Aunque ChatGPT puede proporcionar respuestas a preguntas matemáticas básicas, e incluso a algunas avanzadas, tiene dificultades con problemas más complejos, en particular aquellos que requieren un razonamiento matemático extenso o la manipulación de ecuaciones. En general, los modelos de lenguaje son menos eficaces cuando se trata de disciplinas que dependen más de la lógica formal y los cálculos, que del lenguaje natural.

La inteligencia artificial en las humanidades

Dicho esto, los modelos de lenguaje grande, como ChatGPT, tienen una serie de ventajas potenciales para el campo de las humanidades. Estos modelos pueden ser particularmente útiles para tareas que requieren la generación de texto coherente y relevante, lo cual es común en muchas disciplinas humanísticas. Por ejemplo:

- Ayuda a la investigación

Uno de los usos más prometedores en las humanidades es en el apoyo a la investigación académica. Estos modelos pueden ser utilizados para buscar rápidamente en grandes corpus de texto y extraer información relevante, lo que puede ser invaluable para los investigadores que trabajan con grandes conjuntos de datos textuales.

- Generación de ideas y creatividad

Los modelos de lenguaje grande también pueden ser útiles para generar nuevas ideas y fomentar la creatividad. Al interactuar con estos modelos, los usuarios pueden obtener respuestas inesperadas que podrían desencadenar nuevas líneas de pensamiento.

- Traducción y estudios de lenguas extranjeras

La inteligencia artificial también puede ser una herramienta poderosa para la traducción y los estudios de lenguas extranjeras. Puede proporcionar traducciones rápidas y generalmente precisas entre varios idiomas. Además, puede ser utilizada para generar ejercicios de práctica de idiomas, proporcionar retroalimentación sobre la gramática y la pronunciación, o incluso para simular conversaciones en un idioma extranjero para los estudiantes de idiomas.

- Análisis textual

Finalmente, estos modelos pueden ser utilizados para realizar análisis textuales en gran escala. Pueden identificar patrones y tendencias en grandes conjuntos de datos textuales, hacer análisis de sentimientos o análisis temáticos del texto, lo cual puede ser útil para una variedad de disciplinas humanísticas.

Una extensión de nosotros

Como vemos, los modelos de lenguaje grandes ofrecen una variedad de aplicaciones prácticas, desde la enseñanza y el aprendizaje, hasta la traducción y el análisis textual. Estas herramientas de inteligencia artificial nos permiten interactuar con la información y el texto de formas nuevas y potencialmente más efectivas. Pero, ¿cómo se relacionan estas interacciones con nuestra percepción del mundo y nuestra identidad como seres humanos?

La noción de Dan Ihde de la tecnología como una extensión de nosotros mismos nos ofrece una perspectiva valiosa para considerar esta pregunta. Según Ihde, nuestras interacciones con la tecnología no son neutrales, sino que siempre implican una mediación que transforma nuestra experiencia del mundo (Ihde, 2007, 122). Así, los modelos de lenguaje grandes no son simplemente herramientas que utilizamos; son, en cierto sentido, una extensión de nosotros mismos.

Al igual que una calculadora puede extender nuestra habilidad para el cálculo, los modelos de lenguaje grandes pueden extender nuestra capacidad de procesamiento de la información. Nos permiten analizar y generar texto a una velocidad y escala que superan nuestras capacidades humanas. A medida que nos adaptamos a estos modelos y los integramos en nuestras prácticas diarias, cambia nuestra relación con el texto y la información.

Idhe argumenta que la tecnología no es un mero ente pasivo, sino que es un cointérprete del mundo, por ejemplo, para los navegantes europeos, los mapas y las posiciones de los astros sirven como un “ojo en el cielo” que les permite pensar en el mar como un sistema de coordenadas; no sería posible pensar en el mar de esa manera sin lo humano y lo tecnológico (Ihde, 1990, 56). Por tanto, ¿qué perspectiva nos abre un compañero de diálogo que ha sido entrenado con millones de textos? ¿Qué nos tiene que decir un hablante constituido por millones de ecuaciones? ¿Qué se nos devela frente a un mundo de vida habitado por intelecto humano y no humano?

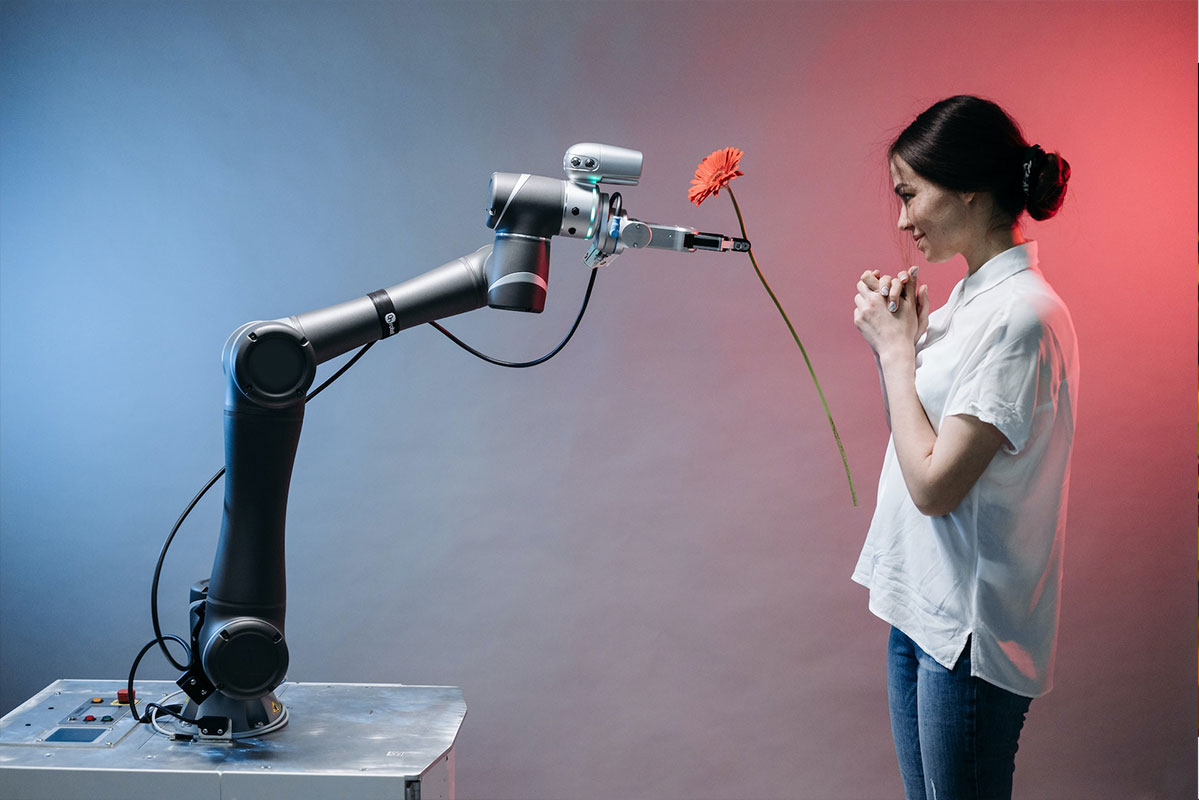

Quisiera cerrar con lo que Ihde llama relación de alteridad, aquella que se da cuando interactuamos con la tecnología como si fuera otro ser. En principio, estos modelos han sido llamados loros estocásticos, en tanto algunos consideran que solo repiten el lenguaje basado en principios estadísticos. Sin embargo, en paralelo a esta mirada un tanto áspera, tenemos implementaciones como Replika, compañeros virtuales creados con inteligencia artificial que brinda acompañamiento y apoyo a sus usuarios.

Esto nos lleva a preguntarnos: ¿estamos en el umbral de una relación de alteridad con estos modelos de lenguaje? ¿Están comenzando a actuar como entidades distintas con las que interactuamos, en lugar de simples herramientas o extensiones de nosotros mismos?

Por supuesto, hay una gran diferencia entre interactuar con un programa de inteligencia artificial y relacionarse con otro ser humano. Pero a medida que estos modelos se vuelven más sofisticados y su presencia en nuestras vidas se vuelve más omnipresente, es posible que comencemos a considerarlos y tratarlos como entidades separadas en sí mismas. Algunos incluso han argumentado que, en cierto sentido, estos modelos de lenguaje están comenzando a exhibir una forma de «vida artificial», una vida que es radicalmente diferente de la vida biológica, pero que aun así implica una forma de existencia y capacidad de interacción significativa.

Por lo tanto, a medida que avanzamos en esta nueva era de la inteligencia artificial y los modelos de lenguaje grandes, es crucial que continuemos explorando estas cuestiones de identidad, alteridad y relación. Estos modelos tienen el potencial de transformar nuestra relación con el lenguaje y la información de maneras que todavía estamos empezando a entender. Si podemos aceptarlos no solo como extensiones de nosotros mismos, sino también como entidades distintas con las que interactuamos, pueden abrir nuevas formas de interacción y comprensión que enriquecerán nuestras vidas y nuestro mundo.

Referencias

- CURRY, D. (15 de mayo de 2023). Home app data ChatGPT revenue and usage statistics (2023). Business of Apps. Recuperado el 25 de junio de 2023. En https://www.businessofapps.com/data/chatgpt-statistics/

- IHDE, D. (1990). Technology and the lifeworld: from Ggarden to earth. Indiana University Press.

- IHDE, D. (2007). Listening and voice: phenomenologies of sound. Second Edition. State University of New York Press.

- LO, C. K. (2023). What is the impact of ChatGPT on education? A rapid review of the literature. Education Sciences, 13(4), 410.

- MCCALLUM, S. (1 de abril de 2023). ChatGPT banned in Italy over privacy concerns. Recuperado el 26 de junio de 2023. En https://www.bbc.com/news/technology-65139406

- PLANAS, C. (11 de mayo de 2023). La Unión Europea endurecerá las normas para usar ChatGPT. El Periódico. Recuperado el 26 de junio de 2023. En https://www.elperiodico.com/es/internacional/20230511/union-europea-inteligencia-artificial-chatgpt-regulacion-bruselas-87197377

- WALTON FAMILY FOUNDATION. (1 de marzo de 2023). Teachers and students embrace ChatGPT for education. Walton Family Foundation. Recuperado el 25 de junio de 2023. En https://www.waltonfamilyfoundation.org/learning/teachers-and-students-embrace-chatgpt-for-education